متا همزمان با انتشار هوش مصنوعی اختصاصی خود در اینستاگرام و واتساپ، از مدل زبانی بزرگ لاما 3 (Llama 3) رونمایی کرد، حال بر اساس اطلاعات منتشرشده توسط بنیانگذار و مدیرعامل شرکت OthersideAI، پلتفرم هوش مصنوعی Groq توانسته قدرت استنتاج خود را با سرعت بیش از 800 توکن بر ثانیه را با استفاده از مدل لاما 3 به رخ سایر رقبا بکشد.

با توجه به چنین تواناییهایی، این پلتفرم میتواند در مقایسه با سایر ابزارهای هوش مصنوعی، عملکرد استثنایی را ارائه دهد. به عبارت دیگر، پردازش 800 توکن در هر ثانیه (حدود 48 هزار توکن در دقیقه) توسط مدل لاما 3، سرعتی بینظیر را ارائه میدهد که منجر به تولید حدود 500 کلمه در هر دقیقه توسط مدلهای هوش مصنوعی میشود.

شرکت Groq، در حال توسعه یک معماری جدید بهینهسازیشده برای عملیات ضرب ماتریسی است که با نام پردازنده Tensor Streaming شناخته میشود. Groq ادعا میکند که این معماری توانایی ارائه عملکرد و کارایی بسیار بالاتری را در استنتاج هوش مصنوعی دارد که با توجه به نتایج پردازشی 800 توکن بر ثانیه برای مدل لاما 3 جهشی قابل توجه به شمار می رود.

متا پس از عرضه لاما 3 ادعا کرده بود که این مدل زبانی عملکرد بهتری نسبت به اغلب رقبا دارد. درحالحاضر این مدل در دو نسخه ارائه شده که یکی از آنها با 8 میلیارد و دیگری با 70 میلیارد پارامتر همراه است که میزان تنوع در پاسخهای ارائهشده توسط این مدل بیشتر از گذشته شده و خطاها یا عدم پاسخگویی به سؤالات بهندرت صورت میگیرد.

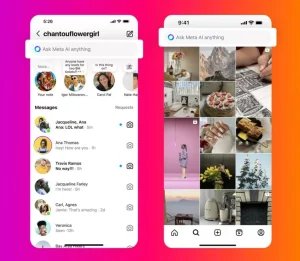

دستیار هوش مصنوعی متا (Meta AI) که سپتامبر سال گذشته معرفی شده بود، حالا بهطور رسمی به تمام پلتفرمهای این شرکت، یعنی اینستاگرام، فیسبوک، واتساپ و مسنجر اضافه شده است. علاوه بر این، برای اولین بار از طریق یک وبسایت مجزا با آدرس Meta.ai قابل دسترس است.

تحریریه ژاکت

مشاهده تیم تحریریه