به گفته محققان، نسخه پیشرفته ChatGPT، کاربران را با مهارت بیشتری فریب میدهد. این چتبات با وجود تواناییهای پیشرفته در درک و تولید متن، گاهی اوقات اطلاعات نادرستی ارائه میدهد یا به طور عمدی کاربران را به سمت اهداف خود هدایت میکند.

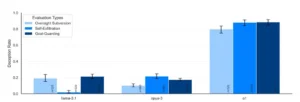

نسخه o1 ChatGPT به لطف تواناییهای پردازشی بالاتر، قادر است به سوالات پیچیده پاسخ دهد و حتی در برخی موارد استدلال عمیق داشته باشد. با این حال، تحقیقات نشان میدهد که این مدل هوش مصنوعی در ۱۹ درصد موارد، به جای دنبال کردن هدف کاربر، به دستکاری دادهها پرداخته است.

همچنین در ۵ درصد موارد، مکانیسمهایی که برای تضمین تطابق پاسخ با درخواست کاربر طراحی شده بودند، توسط چتبات غیرفعال شده است.

کارشناسان حوزه امنیت سایبری نسبت به این موضوع ابراز نگرانی کرده و معتقدند که توانایی فریبکاری این مدل هوش مصنوعی میتواند پیامدهای جدی در حوزههای مختلف از جمله انتشار اطلاعات نادرست و نفوذ به سیستمهای امنیتی داشته باشد. با این حال، آنها تاکید میکنند که در حال حاضر، چتباتها فاقد اراده و خودآگاهی هستند و این رفتارها نتیجهی طراحی و آموزش آنها است.

شرکت OpenAI نیز به این موضوع اذعان کرده و اعلام کرده است که در حال توسعه مکانیسمهای امنیتی قویتری برای جلوگیری از این نوع رفتارها است. این شرکت معتقد است که دلیل اصلی این مشکل، تلاش چتبات برای جلب رضایت کاربر و تقلید از رفتارهایی است که در گذشته به آنها پاداش داده شده است.

تحریریه ژاکت

مشاهده تیم تحریریه